Mitmemõõtmelised meetodid ( multivariate methods )

260 likes | 523 Views

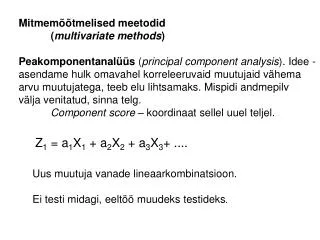

Mitmemõõtmelised meetodid ( multivariate methods ) Peakomponentanalüüs ( principal component analysis ). Idee - asendame hulk omavahel korreleeruvaid muutujaid vähema arvu muutujatega, teeb elu lihtsamaks. Mispidi andmepilv välja venitatud, sinna telg.

Mitmemõõtmelised meetodid ( multivariate methods )

E N D

Presentation Transcript

Mitmemõõtmelised meetodid (multivariate methods) Peakomponentanalüüs (principal component analysis). Idee - asendame hulk omavahel korreleeruvaid muutujaid vähema arvu muutujatega, teebelu lihtsamaks. Mispidi andmepilv välja venitatud, sinna telg. Component score – koordinaat sellel uuel teljel. Z1 = a1X1 + a2X2 + a3X3+ .... Uus muutuja vanade lineaarkombinatsioon. Ei testi midagi, eeltöö muudeks testideks.

Olukord, kus arvutame ühe peakomponendi. Loodusest püütud liblika vanus - ei saa otse mõõta. Sellega korreleerub usutavasti, kuid üksi ei iseloomusta: - kulunud olemine; - katki olemine; - kuupäev.

Kõik korreleeruvad ka omavahel. Võtame kokku üheks peakomponendiks. Sellel uuel teljel koordinaat, see ongi hinnatud vanus ja sedakasutame,

PCA annab sellised tulemused: Ehk siis vanus = 0,56*kulumus+0,58*katkisus+0,59*kuupäev+0,02*suurus. ja iga vaatluse kohta: 1 -2.48 2 -2.74 3 -0.64 4 -0.28 5 0.30 , ära muretse et miinus

Kasutame, kui muutuja väärtus pole mõõdetav - tehnilistel põhjustel; - põhimõtteliselt, nt tuju.

Peakomponent andmepilve telg, aga noid telgi võib olla mitu, üksteisega risti! Kaks peakomponenti, koosluste klassifitseerimine näitena. Objektid: metsalaigud; mõõdetud muutujad: eri taimeliikide ohtrused; hinnatavad muutujad: kasvukoha parameetrid. Olgu neid peamisi kaks – niiskus ja viljakus, arvutame kaks PC ja vastavad PS scored nii: Z1 = a1,1X1 + a1,2X2 + a1,3X3+ .... Z2 = a2,1X1 + a2,2X2 + ..…

Ordination plot:: viljakus niiskus

viljakus Biplot: nõges kanarbik niiskus

Canonical correspondence analysis viljakus CCA biplot niiskus valgustatus

Diskriminantanalüüs - objekti kuulumine klassidesse juba ette teada; - milline uus muutuja - mõõdetud muutujate lineaarkombinatsioon - võimaldab kõige paremini vahet teha. Z1 = a1,1X1 + a1,2X2 + a1,3X3+ .... - selle uue muutuja suhtes koordinaadid igal vaatlusel - ja kriitiline väärtus, mille põhjal otsustatakse uue objekti kuulumine.

Aegrida (time series analysis) - mõõdetud sama muutujat hulga ajavahemike tagant; - tulemuseks siksakiline joon. - autokorrelatsioon - miski aja tagant; - negatiivne - positiivne – korrelogramm. - trend -perioodilisus, ka korrelogrammilt. Ennustuskeskne, aga ka muud asjad võimalikud, seose otsimisel ei tohi teha tavalist regressiooni. Üle 50 vaatluse peab olema.

Bonferroni korrektsiooni millal - kui ühe alltesti posit tulemus on piisav järeldamaks laiema hüpoteesi posit tulemust - - kliimasoojenemise mõju taimede kasvukiirusele - 100 liiki. 5%-s sign tulemus juhuslikult ju - sequential Bonferroni correction, - pane testid tabelisse ritta p-väärtuste kasvamise järjekorras; - esimese testi puhul võrdle saadud p’d väärtusega alfa/k, kus k on testide arv tabelis - kui p on väiksem, kuuluta test oluliseks ja mine järgmise testi juurde - kui pole, siis kuuluta nii see esimene kui ka kõik järgmised testid mitteoluliseks; - kui eelmine punkt ‘lubas’ jätkata, siis järgmise testi korral võrdle p’d väärtusega alfa/(k-1) - kui p on väiksem, kuuluta tulemus oluliseks ja mine edasi, kui pole, lõpeta; - jne, st p’d tuleb võrrelda väärtusega alfa/(k+1-i).

Testi võimsuseks nimetatakse tõenäosust leida statistiliselt oluline seos antud suurusega valimi põhjal olukorras, kus tegelik seos üldkogumis on nii- või naasugune ja disper- sioonid on ka teada, - kaks kasutusala - katse planeerimine - kui suur valim võtta? - järeldamaks midagi negatiivsest tulemusest. Mittesign tulemus iseenesest pole kuigi tugev argument. NB seose puudumist (või olemist täpselt null vms.) ei saa tõestada!

Saab tõestada, et pole suurem kui miski (biol relevantne • väärtus), • ei saanud seost statistiliselt oluliseks, kui aga seos oleks • olnud tugevam kui ...., oleks selle oluliseks saamine • olnud väga tõenäone, kuna me aga ei saanud, siis • ju siis üldkogumis nii tugevat seost ei olnud; • ei kuulu standardprotseduuride hulka; • Lihtsam viis - parameetrite usalduspiirid.

Hüpoteesi testimine: nullhüpotees ja sisukas hüpotees: HO: - erinevust pole; H1: - erinevus on; Esimest tüüpi viga (type I error): kuulutame H1 õigeks, kui ta tegelikult pole; Teist tüüpi viga (type II error): jääme HO juurde, kuigi tegelt on H1 õige.

Informatsioonikriteeriumid mudeli valimisel, AIC – Akaike Information Criterion, IT-approach; rakendub olukordades, kus uurime, millest kõigest mõõdetust sõltuv tunnus sõltub, kase kõrgus metsas.... mitte katses. Saab võrrelda erinevaid mudeleid nende delta-i’de alusel, parimaks kuulutada see, mille AIC on väikseim, - mitte ainult R-ruudu põhjal – keerulisemal alati suurem R-ruut, keerulisusest saab miinuseid; - mitte üksikute efektide p-väärtuste põhjal. .... teeme järeldused kas parimast mudelist või mitmest piisavalt hästi sobivast mudelist – kaalud w. .

Bayesi statistika “.... p on tõenäosus, et valimis nähtav seos on saadud juhuslikult” “... tõenäosusega p üldkogumis seost ei ole.” .... täringuga viskame kuue, .... tavatäringu korral tõenäosus 16,7%, see on p. ... pole ju tõenäosus, et täring on OK. Aga kui teame, et pooltel juhtudel kasutab sohitäringut, saame järeldada, et 85,7% vs 14,3%

Saame täringuga „kuue“; tõenäosus, et on sohitäring (või siis OK täring) sõltub - tõenäosusest saada „6“ õige täringuga; - tõenäosusest, et kasutatakse sohitäringut; Samamoodi, tõenäosus, et üldkogumis r>0, sõltub kahest asjast; - tõenäosusest saada valimi r olukorras, kus r>0; - selliste üldkogumite esinemise tõenäosusest (sagedusest), kus r>0; Kui teist asja teame, saame öelda, et tõenäosusega …. on üldkogum, kus r>0, nagu saime öelda, et tõenäosusega … on sohitäring.

Bayes’i statistika, ... meil on eelnev teave sellest, milline parameetri väärtus on kui tõenäone; .... valimi põhjal muudame oma arusaama; ... tõenäosusega 99% on positiivne seos; .... tavalist p väärtust nii ei tõlgenda!

****************************************************** Päris ausalt peaks hüpotees olema olemas enne andmete vaatamist - ****************************************************** statistika ülesanne pole vastata küsimusele seose põhjuslikkuse kohta. ****************************************************************

ühes rühmas on seos oluline, • teises mitte; • Vormistamine: • täpsus! • nähtavus! • tabel!