Data Mining Using Learning Automata

به نام خدا. Data Mining Using Learning Automata. داده کاوی با استفاده از اتوماتای یادگیر. A year spent in artificial intelligence is enough to make one believe in God. “Alan perlis ”. برگفته از مقالات.

Data Mining Using Learning Automata

E N D

Presentation Transcript

وپول مرجع دانشگاه ومدرسه WWW.pupuol.COM

به نام خدا Data Mining Using Learning Automata داده کاوی با استفاده از اتوماتای یادگیر وپول مرجع دانشگاه ومدرسه WWW.pupuol.COM

A year spent in artificial intelligence is enough to make one believe in God. “Alan perlis”

برگفته از مقالات • Data Mining Using Learning Automata, M. R. Aghaebrahimi, S. H. Zahiri, and M. Amiri • Learning automata based classifier, Seyed-Hamid Zahiri. • Classification Rule Discovery Using Learning Automata- Seyed-Hamid Zahiri

فهرست • چکیده مقاله • داده کاوی • اتوماتای یادگیر • داده کاوی با استفاده از اتوماتای یادگیر • نتایج آزمایشات • منابع و ماٌخذ

چکیده مقاله • در این مقاله یک کاوش کننده داده (data miner) بر پایهاتوماتای یادگیر پیشنهاد شده است که LA-miner نام گذاری شده است. • LA-miner قواعد طبقه بندی را از مجموعه داده ها (dataset) به طور خودکار استخراج می کند.

چکیده مقاله • الگوریتم پیشنهادی بر پایه بهینه سازی که از اتوماتای یادگیر استفاده می کند بنا نهاده شده است. • نتایج عملی نشان می دهد که عملکرد LA-miner پیشنهاد شده قابل مقایسه و در بعضی مواقع بهتر از Ant-miner (الگوریتم کاوش کننده بر مبنای الگوریتم بهینه سازی کلونی مورچه ها) و CNZ (الگوریتم معروف داده کاوی برای طبقه بندی) است.

داده کاوی Data Mining • چرا داده کاوی؟ • تعریف داده کاوی • کاربردهای داده کاوی

چرا داده کاوی؟ دلایل پیدایش داده کاوی: • توسعه تکنولوژيهای ذخيره و بازيابی اطلاعات. • افزايش روزافزون حجم اطلاعات ذخيره شده. • آرشيوهای اطلاعاتی، به دليل حجم بسيار زياد، غالبا به مقبره های اطلاعات تبديل می شوند. • عليرغم هزينه های سنگين در بخش تکنولوژی اطلاعات، بسياری از تصميمها همچنان در فقر اطلاعاتی اتخاذ می گردند و از قابليتهای بالقوه اطلاعات ذخيره شده استفاده نمی شود.

چرا داده کاوی؟ • Europe's Very Long Baseline Interferometry(VLBI)دارای 16 تلسکوپ است که هر کدام از آن ها بالغ بر 1Gigabit/second داده های نجومی در هر دوره 25 روزه تولید می کنند. • آنالیز این داده ها یک مشکل بزرگ است.

چرا داده کاوی؟ • حجم عظیم داده ها در وب جستجوی Google در 4 بیلیون صفحه شامل صدها ترابایت می باشد. • پایگاه داده های امروزی بسیار حجیم هستند.(حجم هایی نظیرGigabytes و terabytes ) بیش از 1,000,000entities/records/rows

چرا داده کاوی؟ • سازمانهایی موفقند که بتوانند حداقل 7% داده هایشان را تحلیل کنند . • تحقیقات انجام یافته نشان داده است که سازمانها کمتر از یک درصد داده هایشان را برای تحلیل استفاده می کنند . به عبارت دیگر در حالی که غرق در داده ها هستند تشنه دانش می باشند. • بنابراین به دانش کشف از داده ها نیاز است.

تعریف داده کاوی • داده کاوی به دانش استخراج از داده ها اشاره دارد و هسته اصلی آن در فصل مشترک یادگیری ماشین، آمار و پایگاه داده است.

وظایف اساسی در داده کاوی • طبقه بندی Classification : تخمین کلاس یک قلم • خوشه بندی Clustering : یافتن خوشه ها در داده • استخراج روابط انجمنی Associations : مثلا غالبا A & B & C رخ می دهند • بصری سازی Visualization : برای تسهیل کشف انسان • خلاصه سازی Summarization : توصیف یک گروه • کشف انحراف DeviationDetection :یافتن تغییرات • تخمین Estimation : پیش بینی یک مقدار پیوسته • تحلیل پیوند LinkAnalysis :یافتن ارتباطات • …

طبقه بندی • یادگیری روشی برای تخمین کلاس نمونه از روی نمونه های (طبقه بندی شده) پیش برچسب خورده. روشهای متنوع : • آمار • درختهای تصمیم گیری • شبکه های عصبی • اتوماتای یادگیر • ...

طبقه بندی • پس از دريافت تعدادی نمونه آموزشی، يادگيرنده بايد دسته نمونه های جديد را مشخص نمايد. مثال: • يک شرکت با بيش از 100000مشتری يک کاتالوگ با هزينه سنگين چاپ و توزيع می کند. • لزوم ارسال انتخابی کاتالوگ (نه برای همه) • دسته بندی: با توجه به سوابق ارسال کاتالوگها و پاسخ مشتريان، چه افرادی احتمالا در گروه ”علاقه مند به محصول معرفی شده“ قرار می گيرند؟ • کاهش هزينه ها

کاربردهای داده کاوی • حوزه های اصلی شامل کاربردهای علمی، تجاری و امنيتی می باشد. • در تمام حوزه ها با حجم بسيار زياد اطلاعات و خصايص متعدد مواجهيم. • کاهش شديد هزينه ها، افزايش درآمدها و نجات زندگی انسانها از دستاوردهای داده کاوی در هريک از حوزه های کاربردی آن است. • کاربردهای تجاری: تشخيص صحت ادعای خسارت در بيمه، تشخيص سوء استفاده از کارتهای اعتباری، تحليل اطلاعات مشتريان يک سازمان،... • کاربردهای علمی: حوزه های پزشکی، جغرافيائی و اقليمی، فضا و سفرهای فضائی • کاربردهای امنيتی: مبارزه با تروريسم، مقابله با نفوذگران به شبکه های کامپيوتری

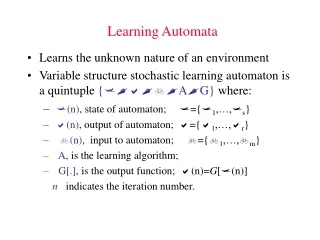

اتوماتای یادگیر LearningAutomata • يک اتوماتاي يادگير را ميتوان بصورت يک شئ مجرد Abstract Object) ) که داراي تعداد متناهي عمل است، در نظر گرفت. • اتوماتاي يادگير با انتخاب يک عمل از مجموعه عمل هاي خود و اِعمال آن بر محيط، عمل ميکند. • عمل مذکور توسط يک محيط تصادفي ارزيابي ميشود و اتوماتا از پاسخ محيط براي انتخاب عمل بعدي خود استفاده ميکند. • در طي اين فرايند اتوماتا ياد ميگيرد که عمل بهينه را انتخاب نمايد.

اتوماتای یادگیر رابطه بین اتوماتای یادگیر و محیط

اتوماتای یادگیر • یکی از مزایای اتوماتای یادگیر این است که به دانش مهمی از محیطی که در آن عمل می کند، و یا به هر دانش تحلیلی از تابعی که باید بهینه شود نیاز ندارد. • یک اتوماتای یادگیر و محیط به طور کلی به ترتیب به وسیله <A,Q, R, L > و <A, R,D > تعریف می شود که: A= { α1, α2,…, αr } : مجوعه همه عمل اتوماتا است. r تعداد کل عمل ها است.در حقیقت A مجموعه خروجی های اتوماتا و همچنین مجموعه ورودی های محیط است.

اتوماتای یادگیر • R دامنه پاسخ های محیط است. • {D = {d1, d2 ,…, drمجوعه پاداش احتمالات است (مجوعه احتمال های جریمه) که . پاداش احتمالات برای اتوماتا ناشناخته است. • Q حالت های اتوماتا است که به طور تعریف می شود. بردار احتمال عمل نامیده می شود. بردار تخمین پاداش احتمال برای نمونه k است.

اتوماتای یادگیر • T الگوریتم یادگیری یا شمای تقویت است که به وسیله اتوماتا به منظور به روز کردن حالات خود استفاده می شود.در حقیقت :

اتوماتای یادگیر • در هر نمونه k، اتوماتا یک عمل α(k)را از مجموعه اعمال A انتخاب می کند.این انتخاب بستگی به بردار عمل جاری P(k)دارد.عمل انتخاب شده α(k) ورودی محیط شده و محیط یک پاسخ تصادفی β(k) می دهد،که به عنوان ورودی اتوماتا محسوب می شود که مقدار مورد انتظار اتوماتا di(k) است. • اگر α(k)= αiسپس اتوماتا Q(k+1) را با استفاده از شمای پاداش L محاسبه می کند.این رویه تا زمانی که عمل بهینه بر محیط پیدا شود ادامه می یابد.

داده کاوی با اتوماتای یادگیر • در این مقاله یک کاوش کننده داده data miner) ) بر پایه اتوماتای یادگیر پیشنهاد شده است که LA-miner نام گذاری شده است. • LA-miner قواعد طبقه بندی را از مجموعه داده ها dataset) ) به طور خودکار استخراج می کند. • الگوریتم پیشنهادی بر پایه بهینه سازی که از اتوماتای یادگیر استفاده می کند بنا نهاده شده است.

داده کاوی با اتوماتای یادگیر • نتایج عملی نشان می دهد که عملکرد LA-miner پیشنهاد شده قابل مقایسه و در بعضی مواقع بهتر از Ant-miner (الگوریتم کاوش کننده بر مبنای الگوریتم بهینه سازی کلونی مورچه ها) و CNZ (الگوریتم معروف داده کاوی برای طبقه بندی) است.

طبقه بندی کننده • طبقه بندی کننده بر مبنای اتوماتای یادگیر بر دو قسمت اصلی بنا نهاده شده است که شامل: • hyperplane تصمیم گیری (Decision hyperplanes) • تابع بهینه سازی که از اتوماتای یادگیر استفاده می کند.(Function optimization)

Hyperplane تصمیم گیری • فرم کلی یک hyperplane به صورت زیر است: • که در آن: • بردار ویژگی افزوده (augmented feature) • ضرایب تعیین کننده ابر صفحه در فضای n بعدی ویژگی ها • در حالت کلی یک تعداد از hyperplane وجود دارد که فضای ویژگی (feature space) را به ناحیه های مختلفی، که هر ناحیه باید با یک کلاس مجزا شناسایی شود جدا می شود.

Hyperplane تصمیم گیری • یک مثال ساده: شامل 6 کلاس، که به وسیله 3 خط تصمیم کد گذاری شده اند.

تابع بهینه سازی با استفاده از اتوماتای یادگیر • در این الگوریتم ابتدا فضای جواب ناآگاهانه به r، hyper-cube که هر کدام مطابق با یک عمل اتوماتای یادگیر است، تقسیم می شود. • سپس با استفاده پیوسته از الگوریتم پیگرد (Pursuit algorithm ) احتمالات عمل ها و تخمین پاداش احتمالات در هر دوره با محاسبه مقدار تابع از یک نمونه انتخابی تصادفی مطابق با حالت جاری عمل بروز می شوند.

تابع بهینه سازی با استفاده از اتوماتای یادگیر • اگر تخمین یک پاداش احتمال از یک آستانه از قبل تعریف شده(predefined threshold ) کوچکتر باشد، hyper-cube متناظر آنگاه بر طبق نمونه های مقدار آن تابع محاسبه می شود. • اگر هر دو مقدار میانگین و واریانس مقادیر این تابع به اندازه کافی کوچک باشند این hyper-cube پایدار و بلااستفاده در نظرگرفته می شود.سپس این hyper-cube خارج می شود و بهینه سازی با r-1، hyper-cube باقی مانده ادامه می یابد.

تابع بهینه سازی با استفاده از اتوماتای یادگیر • در غیر این صورت این hyper-cube به عنوان ناپایدار درنظر گرفته می شود و افزایش و کاهش (قله و دره) این تابع در این از نمونه های داخل آن تخمین زده می شود. • سپس این hyper-cube به تعدادی زیر hyper-cube که هرکدام فقط شامل نمونه های صعودی یا نزولی هستند تقسیم می شوند و hyper-cube اصلی به وسیله بهترین پاداش زیر hyper-cube جایگزین می شود و hyper-cube های دیگر بلااستفاده در نظر گرفته شده و خارج می شود.

تابع بهینه سازی با استفاده از اتوماتای یادگیر • این رویه تا زمانی که یک شرط دقیق از قبل تعریف شده ارضا شود تکرا می شود.سپس hyper-cube اصلی خارج می شود و یا به چندین مقدار که شامل شبه بهینه سراسری است همگرا می شود. • مانند دیگر الگوریتم های بهینه سازی غیرقطعی، هدف این روش پیدا کردن یک توافق(سازش) بین کاوش و استخراج است.به عنوان مثال همگرا شدن به نزدیک ترین بهینه محلی و کشف رفتار تابع به منظور کشف ناحیه سراسری است. • برنامه زمانبندی تابع بهینه سازی برپایه اتوماتای یادگیر دراسلاید بعد داده شده است.

داده کاوی با اتوماتای یادگیر • دانش کشف شده توسط LA-miner در قالب قاعده های if-then نمایش داده می شود. • Antecedent رول ها شامل مجموعه ای از شرایط است که معمولاً توسط توسط عملگر اتصال منطقی AND) ) به هم متصل شده اند.هر شرط معمولاً به یک ترم (گزاره) اشاره می کند. • Consequentرول (قسمت Then ) کلاس های پیش بینی شده برای نمونه هایی که قسمت antecedent رول ها را ارضا می کنند را مشخص می کند.

LA-miner پیشنهاد شده • LA-miner پیشنهادی ما برپایه الگوریتم تابع بهینه سازی طراحی شده است که از روش اتوماتای یادگیر استفاده می کند.برای توضیح اینکه چطور LA-miner رول های if-then را استخراج می کند،ساختار یک رول را در نظر بگیرید: • IF ( att1 is quant1) AND (att2 is quant2 ) AND … (attn is quantn) THENx belongs to Class j

نتایج محاسباتی و مقایسه • در این بخش ارزیابی عملکرد LA-miner پیشنهاد شده بررسی شده است.همچنین نتایج مقایسه با Ant-miner و CNZ ارائه شده است. • Ant-miner یک الگوریتم برای طبقه بندی قواعد کشف شده است که کلونی مورچه های بهینه سازی شده را بکار می برد. • CNZ یک الگوریتم مشهور طبقه بندی قواعد کشف شده است.

مجموعه داده ها (Data Sets) • داده های زنبق (Iris) داده های زنبق شامل 50 اندازه گیری از 4 ویژگی از هر سه نوع گونه ی • زنبق خاردار (Iris setosa)، • زنبق رنگارنگ (Iris versicolor) • زنبق ورجینیکا (Iris virginica) ویژگی ها طول کاسبرگ sepal length))، عرض کاسبرگ (sepal width)،طول گلبرگ (Petallength ) و عرض گلبرگ (petalwidth) است. Iris setosa Iris virginica Iris versicolor

مجموعه داده ها (Data Sets) • داده های شراب (Wine data) داده های wine شاما آنالیز شیمیایی رشد شراب در ناحیه یکسان از ایتالیا اما گرفته شده از موجودات ذره بینی گوناگون است.برای طبقه بندی 13 ویژگی پیوسته در دسترس است.تعداد کلاس ها 3و تعداد نمونه های هر کلاس به ترتیب 59، 71 و 48 است. • داده های سرطان (Cancer data) این پایگاه داده سرطان سینه از بیمارستان دانشگاه Wisconsin به دست آمده است.683 نمونه سرطان سینه به دو کلاس Benign و Malignant با 9 بعد فضای ویژگی تقسیم شده اند.

نتایج آزمایش ها • LA-miner ، Ant-miner و CNZ بر روی مجموعه داده های بالا تست شده اند. • 50 درصد از هر محک به عنوان training points و مابقی testing data است. • آزمایش ده بار برای هر محک انجام شده و میانگین نتایج گزارش شده است.

نتایج آزمایش ها • جدول 1 نمره تشخیص (recognition score) به دست آمده از Rule-Set که توسط سه data miner استخراج شده برای training points را نشان می دهد.