要論B 講義日程

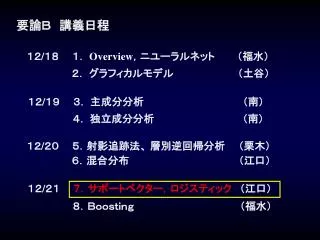

要論B 講義日程 . 12 / 18 1. Overview ,ニユーラルネット (福水) 2. グラフィカルモデル (土谷). 12 / 19 3. 主成分分析 (南) 4. 独立成分分析 (南). 12 / 20 5.射影追跡法、 層別逆回帰分析 (栗木)

要論B 講義日程

E N D

Presentation Transcript

要論B 講義日程 12/18 1. Overview,ニユーラルネット (福水) 2. グラフィカルモデル (土谷) 12/19 3. 主成分分析 (南) 4. 独立成分分析 (南) 12/20 5.射影追跡法、 層別逆回帰分析 (栗木) 6.混合分布 (江口) 12/21 7.サポートベクター,ロジスティック (江口) 8.Boosting (福水)

ニユーラルネット グラフィカルモデル 主成分分析 独立成分分析 層別逆回帰分析 混合分布 Boosting サポートベクター

7.サポートベクターマシンと ロジスティック回帰 世の中、多くの問題は分類の問題に帰着できる。 そして永遠の未解決問題でもある。 もしこの問題が解決されるなら、投資家は決して損をしないだろうし 天気予報官は、確率予測をしなくてもよくなり、世の中に失恋も、倒産も なくなるかもしれない….

確率モデルとして,分布が混合されることのクリアな説明を試みる.確率モデルとして,分布が混合されることのクリアな説明を試みる. ○ 潜在変量=グループ・ラベルの理解 ○ 最尤推定値を求める EM アルゴリズムの紹介 ○ 例題として,神経回路の量子解析のシナプス可塑性 分類の問題を考えるとき,確率モデルを考える必要性を強調する. 確率モデルは混合分布モデルのある類推から導入する. ○ ベイズルールの最適性を示す. ○ パラメトリックモデル,特に線形モデルを仮定して,プラグインルールの説明をする. このフレイムワークの下で ロジスティック判別は自然に導入されることを示す. ○ トレーニング・ロス,汎化誤差の説明をする. ○ サポートベクター・マシンの説明 ○ VC次元の説明 ○ カーネル法の説明 混合分布 サポートベクター

分類方法のための解析 (判別分析) 参考文献 [1] Krazanowski, W. J. & Marriott, F.H.C. Multivariate Analysis, (1995) Arnorld, New York [2] Bishop, C. M. Neural Networks for Pattern Recognition. (1996). Oxford University Press. [3] McLachlan, G. J. Discriminant Analysis and Statistical Pattern recognition. (1992). Wiley, New York. [4] Haykin, S. NEURAL NETWORKS (1999). PRENTICE HALL 統計多変量解析の観点から ISBN 0340593253 ニューラルネットの教科書 ISBN 0198538642 統計の専門書,空間判別,ニューラルネットISBN0471615315 最近の機械学習,ニューラルネットの紹介 ISBN 0132733501

[5] Harry Hochstadt, INTEGRAL EQUATIONS, Wiley, New York. [6] Jerome Friendman, Trevor Hastie, Robert Tibshirani, Additive logistic regression: A statistical view of boosting, (2000) Annals of Statistics. [7] Alex J. Smola, Bernhard Schölkopf, A Tutorial on Support Vector Regression (1998) NeuroCOLT. [8] Steve Gunn, Supprt Vector Machines for Classification and Regression, (1998) ISIS Technical Report. [9] C. J.C. Burges, A tutorial on Support Vector Machine for Pattern Recognition, Kluwer Academic Publishers. カーネルの 数学書 ホットな話題 チュウトリアル

を決める。 入力 のパタンから出力 分類の問題 トレーニングデータ によって を定める。 文字認識 (郵便番号の自動読み取り) 応用例 ● ● 音声認識 (電話チケット自動予約) 画像認識 (交通量計測・予測) ● ☆ クレジットスコアリング メディカルスクリーニング ☆ 鑑定問題 ☆ 天気予測 ☆

分類の方法 トレーニングデータ i 番目の出力 i 番目の入力

方法 : かってな x が与えられた時, 関数 g(x)を使って 次のようにのように y を予測する. d = 2 目的 : トレーニングデータ を使って 良い判別関数 g(x) の構成.

直感的な学習:関数 g(x) が次の条件を満たしなさい: 上の条件を満たす 関数 g(x) は無尽蔵に存在する. そこで,関数 g(x) を線形に限ろう: 上の条件を満たす線形関数 g(x) の存在は絞られるが完全ではなく,存在しないケースがある.

線形なモデルの意味 回帰の問題を復習しよう: 確率モデルを建てよう ここで は,誤差を表す.

最小2乗法 = min SS 最尤法 = max Likelihood 誤差分布 が ガウス分布 ならば, 最小2乗法 = 最尤法

直感的な学習:関数 g(x) が次の条件を満たしなさい: ? 確率的設定を考えよう とする。 入力 x と 出力 y の同時分布を 判別関数 g によるルールの誤判別確率をロスにした時の 汎化誤差は ! min 経験誤差は min

直感的な学習 AIC, CV,…. トレーニングデータ, テストデータ

事前分布 から事後分布 への変化 の同時分布2つの条件付け: ベイズの定理 の中から1つ選ぶルールを からクラス ベイズルール: 入力 で定める。

ベイズルールによる判別空間 の 誤判別確率 の良さについて見てみよう 一般に、判別 ルール が 与えられたとき 誤判別 の 確率は で与えられる。

4 2 -6 -4 -2 2 4 6 -2 -4

以上の考察の結論 入力 と出力 の同時確率の分布 がわかっているなら ベイズルール が最適である。 問題点 が わかっている状況は ほとんどのケース ありえない。 そこで, 次にパラメトリックケース: 分布は未知だけど、分布形 ( パラメトリック形 ) はわかっている を考えよう

仮定: 指数型 (ここで y=±1) すると ここで

が指数型ならば ベイズルールによる判別関数は と成る. を学習すれば良い. 結論はトレーニングデータから

トレーニングデータ に対して 条件付尤度は と書ける これを使って を ロジスティック判別関数と呼ぶ。

学習率 を求めるアルゴリズム 勾配法 反復重み付け最小二乗法 などがある

フィッシャー の線形判別関数 の仮定ではベイズルールと 書かれる を計算すると より が計算される。 これを フィッシャーの線形判別関数 と呼ぶ

入力データベクトルが,グループ内で 多変量正規分布して,グループ間では 平均のみ異なると仮定する フィッシャー線形判別 入力データベクトルが,指数型分布 して,グループ間ではパラメータが 異なると仮定する ロジステック判別 サポートベクターマシン マージン最大化

超平面の幾何 ここで を の 超平面と呼ぶ の法線ベクトルは である。 ●

法線 の直交補空間を と表す この時 と書ける

さて を取ろう。この時、 と書ける。ここで これより なので

このように 点 から への距離は となる これから は、直交補空間 を原点 から だけ平行移動したものといえる

サポートベクターマシン 超局面 の w は超局面と 1:1 でない. このとき この等号を満たす をサポートベクターと呼ぼう.

サポートベクターを含む2平面 と の間の距離は となる。 とおくと、 の最大化は の最小化と同値なので サポートベクターマシンは次の形で定義される。 Subject to

双対問題 主問題のラグランジュ関数は

クーン タッカー条件より サポートベクターマシンによる判別関数は

パタンが線形分離可能でないとき、 スラック変数 は、1 を越える時上の図に対応する。 主問題 双対問題

カーネル法 入力ベクトル x から特徴ベクトルへの写像を とすると の線形な判別関数 サポートベクターマシンによる学習は を解いて実行される

サポートベクターマシンは, を作る. これから, 内積カーネルを と定めれば

の具体的な形は必要でなく 特徴ベクトル 内積カーネル さえ与えれば実行できる 例題 例えば,d = 2 の場合

例題 XOR 問題 トレーニングデータ 入力 x 出力 y 内積カーネル (-1, -1) + 1 (-1, + 1) -1 ( + 1, -1) -1 ( + 1, + 1) + 1

この性質はカーネルサポートベクターマシンだけの良さなのだろうか?この性質はカーネルサポートベクターマシンだけの良さなのだろうか?

命題 y ( +1, +1, + 1, + 1,-1, -1) (-1,-1, + 1, -1 + 1, -1 )(-1,-1, + 1, -1-1, + 1) ( +1, +1, + 1, + 1 + 1, + 1) 例題 XOR 問題 の 問題 では サポートベクターは 2次 カーネルを使えば 良い性質が示された. しかし,この良さは、 ロジスティック も アダブーストも 同様に 持っている性質 である。

フィッシャー線形判別 ロジステック判別 ベイズルールの パラメトリック版 サポートベクターマシン マージン最大化 確率的考察ではない VC 次元の考察 .. . .

グラフィカルモデル ニユーラルネット 主成分分析 独立成分分析 層別逆回帰分析 混合分布 ラベルミッシング サポートベクター Boosting

混合分布モデル 成分分布 混合比 混合分布 ダミー(潜在)変数 Z の導入 4 2 1 3