上节课内容

上节课内容. [ESL] Chp2 中一些重要的观点 … 目标:找到一个“ 好 ”的模型,根据一些预测子 预测变量 Y 好 : 风险 (期望预测误差) 最小 : 答案: ,但是 … 是什么 ? 期望预测误差分解: 若 ,其中 且 为模型 的估计. 偏差 — 方差折中. 线性回归模型. 线性回归模型:假设 是线性的: 线性回归模型是一个古老的工具,但 仍然很有用 …

上节课内容

E N D

Presentation Transcript

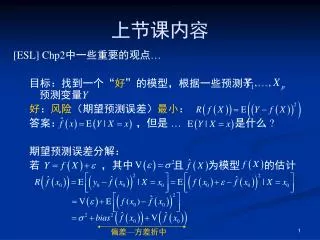

上节课内容 [ESL] Chp2中一些重要的观点… 目标:找到一个“好”的模型,根据一些预测子 预测变量Y 好:风险(期望预测误差)最小: 答案: ,但是 … 是什么? 期望预测误差分解: 若 ,其中 且 为模型 的估计 偏差—方差折中

线性回归模型 线性回归模型:假设 是线性的: 线性回归模型是一个古老的工具,但仍然很有用… • 简单,有封闭形式的解 • 对回归效果很容易进行解释 • 应用广泛,因为Xi可以为任何变量的任何函数 • 如

假定 ,其中 假定 。 在一维情况下,未知参数为斜率 和截距 令 和 分别表示 和 的估计,则匹配的线为 预测值/匹配值为 残差为 一元线性回归

点估计 • 最小二乘(least squares)估计为使得残差平方和 最小的 和 : • 的无偏估计为:

标准误差和置信区间 • 的1-α置信区间为:

若要检验假设 ,可用Wald检验统计量 ,如果 ,拒绝 也可用p-value计算: 未知时, 的真正分布为t分布: 但样本数n较大时,可用正态分布近似 假设检验

预测及其标准误差 • 预测为:

预测误差 • 在观测 处,响应的真值为 • 则预测误差为 • 预测的1-α置信区间:

例:[Weiss]13.6 • 例13.6(2001年总统选举): • Y:Buchannan 的得票数 • X:Bush 的得票数 当残差是随机正态分布时, 线性回归的推断是最精确的

例:[Weiss]13.6 • 例13.6(续): • Y:log (Buchannan 的得票数 ) • X:log ( Bush 的得票数 ) 残差分布更合理?

例:[Weiss]13.10 • 对例13.6中的选取数据,对两个票数取log后, • 95%置信区间为: • 检验 ,Wald统计量为: • 这是证明斜率不等于0的充分证据。

例:[Weiss]13.12 • 在一个新的城市Palm Beach, • X = log ( Bush 的得票数 ) = log (152954) = 11.93789 • 真值 Y = log (Buchannan的得票数 ) = log (3467) = 8.151045 • 而根据模型得到预测值为 • 预测误差为:, • 95%置信区间为:(6.200, 6.578),不包含真值8.151045,预测值显著小于真值 • 不取log的回归模型得到预测误差的95%置信区间为:(493, 717),而实际票数为3467

最小二乘估计与MLE • 线性回归模型为 • 其中 互相独立且 • 若我们施加一更强的假设 ,即 • 其中 • 则似然函数为

最小二乘估计与MLE • 其中 与 无关,所以主要关注条件似然 • log条件似然为 • 所以最小二乘估计的结果也是极大似然估计 • 且方差 的极大似然估计为

更一般地,当输入向量X为一个p维向量时,称为p元线性回归更一般地,当输入向量X为一个p维向量时,称为p元线性回归 数据对为 ,权重向量为 。为了包括所有的截距项,我们给每个特征增加一维,并置为1,通常将其放在第一列,即 则模型变为 其中 ,并假设所有的观测有相同的方差 多元线性回归

输入矩阵: ,输出向量: 噪声向量为 ,参数向量 则线性回归模型为: 多元线性回归:矩阵形式

最小二乘估计:残差项的平方和最小 这是一个p+1个参数的二次方程,对 求导数并使导数为0: 最小二乘估计

最小二乘估计的性质 • 假设 的矩阵 可逆,则 • 的一个无偏估计为 • 其中 为残差项(residual) 在给定 的条件下 无偏性 一致性 渐近正态性

的 近似置信区间为 其中 是矩阵 对角线上第j个元素 若要检验假设 ,可用Wald检验统计量 ,如果 ,拒绝 也可用p-value计算: 未知时, 的真正分布为t分布: 但样本数n较大时,可用正态分布近似 假设检验

若要检验一组系数的显著性,可用F统计量: 其中: :有 个参数的较大模型的最小二乘拟合的残差平方和 :有 个参数的较小模型的最小二乘拟合的残差平方和,即较大模型中的 个参数被约束为0 F的分布为 当n较大时,近似为 最小二乘估计的性质 残差平方和随 变量数目的变化

预测 • 考虑在观测 处,相应的估计值为 • 则该估计是无偏的

预测误差 • 在观测 处,响应的真值为 • 则预测误差为 • 预测的1-α置信区间:

例:[ESL] 3.2.1:前列腺癌 • 考察前列腺癌特殊抗原水平(lpsa: log prostate specific antigen)与一些临床指标之间的相关性 • lcavol:log cancel volume (肿瘤体积) • lweight:log prostate weight (前列腺重量) • age:(年龄) • lbph:log bengin prostatic hypcrplasia (良性前列腺增生量) • svi:seminal vesicle invasion (精囊浸润) • lcp:log of capsular penetration (包膜穿透) • gleason:gleason score (Gleason积分) • pgg45:percent of Gleason scores 4 or 5 ( Gleason4/5所占百分比 )

Wald统计量 注意:lcp不是显著的,这是由于lcp与lcavol强相关 如果模型中不包括lcavol ,则lcp 是显著的

考虑删除所有非显著项:age, lcp, gleason, pgg45(上表中的未标红色的项) • p值=0.17( ) • 所以不是显著反对原假设:这些项可以删除

上述结果是在67个训练数据上的结果 • 在30个校验数据上的平均预测误差为0.545 • 若用训练集上lpsa的均值作为预测结果,则测试误差为1.05,称为“基本误差率” • 因此,线性模型将基本误差率大约降低了50%

残差 最小二乘估计的几何解释(1) • 最小化残差的平方和RSS

最小二乘估计的几何解释(2) • RSS的一阶导数=0,得到 • X的列向量组成的n维子空间与残差向量 正交

最小二乘估计的计算 • 但一般不直接计算矩阵的逆。 • 实际应用一般采用QR分解,因为QR分解比较有效,只需要 次操作,同时数值稳定

下节课内容 • 线性回归中的模型选择 • 子集选择 • 结构化的线性回归 • 岭回归 • Lasso