D. Backpropagation

D. Backpropagation. Pembelajaran terawasi dan biasa digunakan perceptron dengan banyak lapisan untuk mengubah bobot-bobot yang terhubung dengan neuron-neuron yang ada pada lapisan tersembunyinya. Menggunakan error output untuk mengubah nilai bobot-bobotnya dalam arah mundur (backward).

D. Backpropagation

E N D

Presentation Transcript

D. Backpropagation • Pembelajaran terawasi dan biasa digunakan perceptron dengan banyak lapisan untuk mengubah bobot-bobot yang terhubung dengan neuron-neuron yang ada pada lapisan tersembunyinya. • Menggunakan error output untuk mengubah nilai bobot-bobotnya dalam arah mundur (backward). • Error ini didapat melaui tahap perambatan maju (forward propagation) harus dikerjakan dahulu.

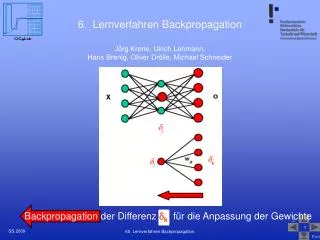

Algoritma backprop • Inisialisasi bobot (ambil bobot awal dengan nilai random yang cukup kecil) • Kerjakan langkah-langkah berikut selama kondisi berhenti bernilai FALSE • Untuk tiap-tiap pasangan elemen yang akan dilakukan pembelajaran, kerjakan feedforward

feedforward • tiap-tiap unit input (xi , i=1,2,3,…,n) menerima sinyal xi dan meneruskan sinyal tersebut ke semua unit pada lapisan yang ada diatasnya (lapisan tersembunyi) • Tiap-tiap unit tersembunyi (zj, j= 1,2,3,..p) menjumlahkan sinyal-sinyal input terbobot gunakan fungsi aktivasi untuk menghitung sinyal outputnya zj = f(z_inj) dan kirimkan sinyal tersebut ke semua unit di lapisan atasnya (unit-unit output)

c. tiap-tiap unit output (yk, k=1,2,3,..m) menjumlahkan sinyal-sinyal input terbobot gunakan fungsi aktivasi untuk menghitung sinyal outputnya : yk = f(y_ink) Dan kirimkan sinyal tersebut ke semua unit di lapisan atasnya (unit-unit output)

Backpropagation d. Tiap-tiap unit output (yk, k=1,2,3,…,m) menerima target pola yang berhubungan dengan pola input pembelajaran,hitung informasi errornya Kemudian hitung koreksi bobot (yang nantinya akan digunakan untuk memperbaiki nilai wjk)

Hitung koreksi bias (yang nantinya akan digunakan untuk memperbaiki nilai wok) Kirimkan δk ini ke unit-unit yang ada di lapisan bawahnya

e. Tiap-tiap unit tersembunyi (zj, j=1,2,3,…,p) menjumlahkan delta inputnya (dari unit-unit yang berada pada lapisan diatasnya) Kalikan nilai ini dengan turunan dari fungsi aktivasi-nya untuk menghitung informasi error

Kemudian hitung koreksi bobot (yang nantinya akan digunakan untuk memperbaiki nilai vij) Hitung juga koreksi bias (yang nantinya akan digunakan untuk memperbaiki nilai v0j)

f. Tiap-tiap unit output (yk , k=1,2,3,..m) memperbaiki bias dan bobotnya (j=0,1,2,…,p) wjk(baru) = wjk(lama)+Δwjk Tiap-tiap unit tersembunyi (zj, j =1,2,3,…,p) memperbaiki bias dan bobotnya (i=0,1,2,..,n) vij(baru)=vij(lama)+Δvij 2. Tes kondisi terhenti

e. Learning Vector Quantization • Metode pembelajaran pada lapisan kometitif yang terawasi • Lapisan kompetitif akan secara otomatis belajar untuk mengklasifikasikan vektor-vektor input • Kelas-kelas yang didapatkan sebagai hasil dari lapisan kompetitif ini hanya bergantung pada jarak antara vektor-vektor input • Jika 2 vektor input mendekati sama maka lapisan kompetitif akan meletakkan kedua vektor input tersebut kedalam kelas yang sama

Algoritma • Tetapkan bobot (w), maximum epoh (maxEpoh), error minimum yang diharapkan (Eps), Learning rate(α) • Masukkan input : x(m.n) Targetm : T(1,n) 3. Tetapkan kondisi awal: epoh : 0 err :1

4. Kerjakan jika: (epoch<MaxEpoh) atau (α>eps) • epoh=epoh+1 • Kerjakan untuk i=1 sampai n i. Tentukan J sedemikian hingga ||x-wj|| minimum (sebut sebagai Cj)

ii. Perbaiki wj dengan ketentuan - Jika T = Cj maka: wj(baru)=wj(lama)+α(x-wj(lama)) - Jika T≠Cj maka wj(baru)=wj(lama)-α(x-wj(lama)) c. Kurangi nilai α

Unsupervised Learning (jaringan Kohonen) • Diperkenalkan oleh Prof. Teufo Kohonen 1982 • Pada jaringan ini suatu lapisan yang berisi neuron-neuronn akan menyusun dirinya sendiri berdasarkan input nilai tertentu dalam suatu kelompok yang dikenal dengan istilah cluster

Selama proses penyusunan diri,cluster yang memiliki vektor bobot paling cocok dengan pola input (memiliki jarak yang paling dekat) akan terpilih sebagai pemenang • Neruon yang menjadi pemenang beserta neuron-neuron tetangganya akan memperbaiki bobot-bobotnya

Algoritma 0. Inisialisasi bobot wij set parameter-parameter tetangga set parameter learning rate • Kerjakan jika kondisi berhenti bernilai FALSE a. Untuk setiap vektor input x , kerjakan - Untuk setiap j, hitung

- Tentukan J, sedemikian hingga D(J) minimum - Untuk setiap unit j dengan spesifikasi tetangga tertentu dan untuk setiap I wij(baru)=wij(lama)+α(xi-wij(lama)) b. Perbaiki learning rate c. Kurangi radius ke tetanggaan pada waktu-waktu tertentu

d. Tes kondisi berhenti Tugas Buat Rangkuman tentang Genetic Algoritm